I. Une réalité statistique tenace

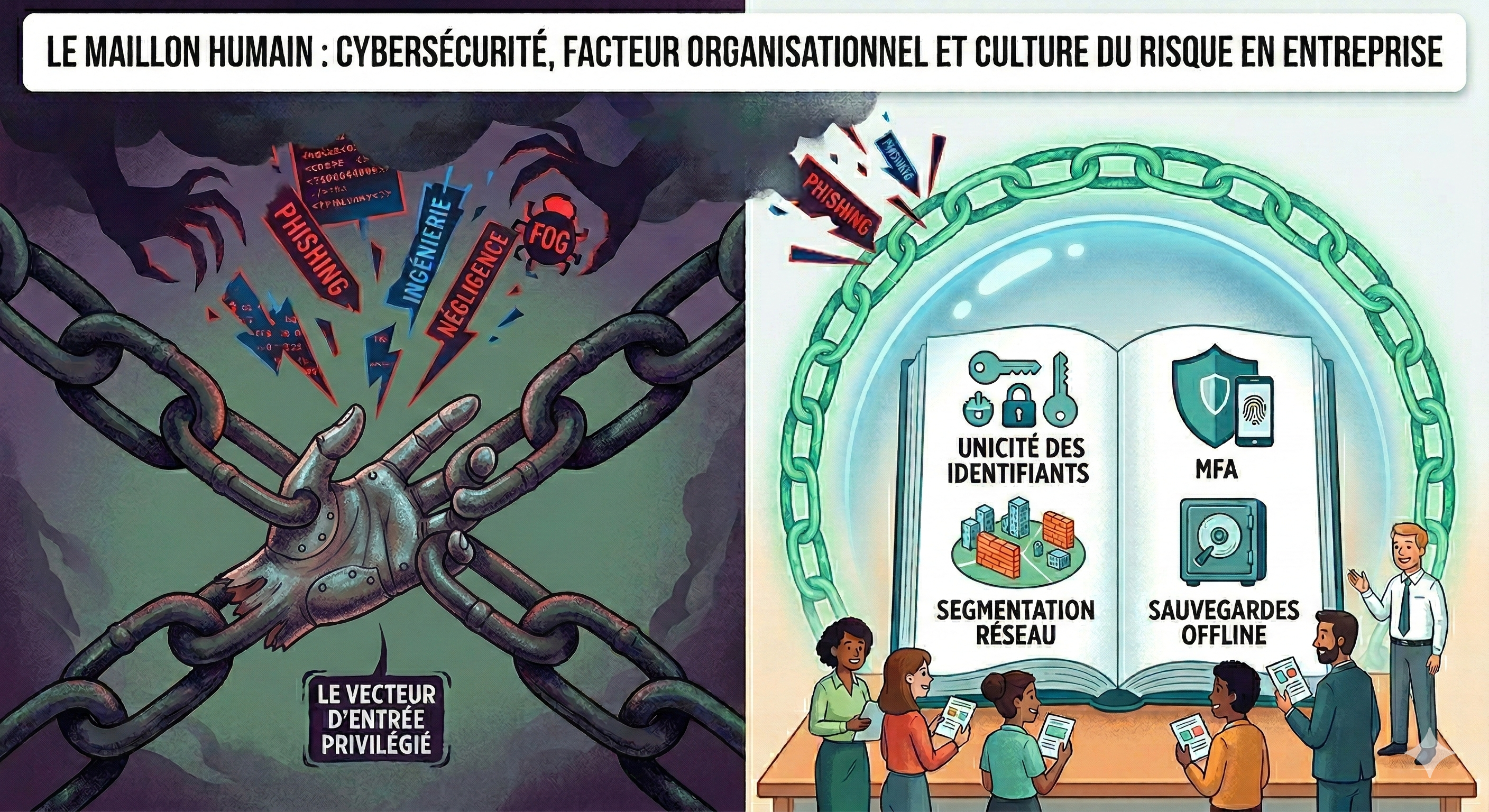

La cybersécurité est fréquemment appréhendée à travers le prisme exclusivement technique : firewalls, systèmes de détection d'intrusion, chiffrement des communications, mises à jour critiques. Cette lecture, bien que légitime, tend à occulter une réalité statistique tenace. Selon les données publiées par l'Agence nationale de la sécurité des systèmes d'information (ANSSI), ainsi que par le World Economic Forum dans son rapport annuel sur les risques globaux, plus de 80 à 90 % des cyberattaques abouties exploitent non pas une faille logicielle inédite, mais une erreur humaine. Qu'il s'agisse d'un clic irréfléchi sur un lien malveillant, d'un mot de passe réutilisé, d'une pièce jointe ouverte sans précaution ou d'une information communiquée sous l'effet de la manipulation, le comportement de l'utilisateur demeure, dans la quasi-totalité des scenarii d'intrusion, le vecteur d'entrée privilégié des attaquants.

Ce constat n'est pas anodin. Il implique que les investissements consentis dans des infrastructures de sécurité techniquement sophistiquées peuvent être réduits à néant par un seul collaborateur insuffisamment sensibilisé. Il souligne également que la cybersécurité ne saurait être considérée comme un domaine exclusivement réservé aux équipes informatiques, mais relève d'une responsabilité partagée à l'échelle de l'ensemble de l'organisation. Comprendre pourquoi l'humain représente ce maillon faible, en analyser les mécanismes, et identifier les leviers permettant d'y remédier : telle est la démarche que cet article se propose d'engager.

II. L'ingénierie sociale, ou l'exploitation de la psychologie humaine

Le concept d'ingénierie sociale (social engineering) désigne l'ensemble des techniques par lesquelles un attaquant cherche à manipuler psychologiquement une personne afin d'obtenir d'elle une action ou une information utile à ses fins malveillantes. Contrairement à l'intrusion technique classique, l'ingénierie sociale ne cherche pas à contourner un système de protection — elle cherche à obtenir qu'une personne légitime le contourne elle-même, à son insu. Le phishing, ou hameçonnage, en constitue la forme la plus répandue : il s'agit d'une communication frauduleuse, généralement un courriel, imitant l'identité visuelle d'une entité de confiance dans le but d'inciter le destinataire à saisir ses identifiants sur une page frauduleuse ou à exécuter une action compromettante.

La forme évoluée du phishing, le spear phishing, cible un individu précis avec des informations personnalisées collectées sur les réseaux sociaux ou dans les bases de données d'organisations préalablement compromises, rendant la détection bien plus difficile. Ces techniques exploitent des mécanismes cognitifs profondément ancrés dans la psychologie humaine : le sentiment d'urgence, l'autorité perçue d'un expéditeur hiérarchique, la peur de conséquences immédiates, ou encore la simple inattention liée à la surcharge informationnelle quotidienne.

Un utilisateur qui reçoit un courriel l'invitant à changer son mot de passe sous peine de voir son compte bloqué, en pleine journée de travail chargée, est cognitivement vulnérable — non par incompétence, mais par des mécanismes que les sciences comportementales documentent abondamment. L'attaquant ne cherche pas à vaincre un système, il cherche à exploiter une personne.

À ces formes actives de manipulation s'ajoutent des vecteurs passifs tout aussi redoutables : la négligence ordinaire. L'utilisation de mots de passe faibles ou partagés entre plusieurs services, l'absence de mise à jour des logiciels, la connexion à des réseaux Wi-Fi publics sans recours à un VPN, le stockage de fichiers sensibles sur des supports non chiffrés, ou encore l'absence de verrouillage automatique des postes de travail constituent autant de brèches structurelles. Ces comportements ne sont généralement pas malveillants ; ils résultent d'un défaut de culture du risque numérique, souvent entretenu par l'absence de formation et de procédures claires.

L'attaque subie par l'Université de Guyane au printemps 2024 offre une illustration remarquablement didactique des conséquences concrètes d'un déficit de culture cybersécurité au sein d'une institution publique. Le 30 avril 2024, la Direction du numérique de l'établissement détecte des flux anormaux sur ses systèmes et reçoit des signalements d'enseignants signalant des difficultés de connexion aux serveurs. Une cellule de crise est activée dès le lendemain, et la nature de l'incident est confirmée le 2 mai : il s'agit d'une attaque par ransomware orchestrée par le groupe cybercriminel FOG, spécialisé dans le ciblage des établissements d'enseignement supérieur. Les fichiers de l'université ont été chiffrés, certains effacés, leurs extensions portant désormais la signature « .fog ». Le site internet de l'établissement est entièrement détruit, plusieurs applications pédagogiques et administratives rendues inopérantes, forçant l'arrêt complet des serveurs.

Le vecteur d'entrée de l'attaque mérite une attention particulière, car il illustre avec une netteté saisissante la thèse centrale de cet article. L'enquête technique a établi que le groupe FOG avait obtenu un accès initial à l'infrastructure de l'université en utilisant des identifiants VPN valides appartenant à un membre du personnel. Ces identifiants n'avaient pas été dérobés lors d'une attaque sophistiquée contre l'université elle-même : ils provenaient d'une fuite de base de données d'un service externe, survenue environ cinq ans auparavant, sur lequel l'utilisateur avait enregistré les mêmes identifiants que ceux de son compte professionnel. Ce mécanisme, connu sous le nom de credential stuffing ou bourrage d'identifiants, consiste pour les attaquants à injecter automatiquement des couples identifiant/mot de passe issus de fuites antérieures sur des cibles d'intérêt, en pariant — souvent avec raison — sur la réutilisation des mêmes combinaisons. Dans ce cas précis, une négligence individuelle commise des années plus tôt, sur un service sans lien apparent avec l'institution, a suffi à ouvrir en grand les portes du système d'information d'une université entière.

Une fois à l'intérieur du réseau via le VPN compromis, le groupe FOG a procédé méthodiquement : escalade de privilèges par des techniques de pass-the-hash, déplacement latéral via les protocoles RDP et SSH, désactivation des outils de détection Windows Defender, et enfin déploiement du ransomware. Les attaquants ont déposé un fichier texte réclamant le versement d'une rançon via le dark web. La direction a refusé de céder, fait déposer une plainte et engagé un audit technique avec la société Exodata. Des mesures d'urgence ont maintenu la continuité pédagogique par des canaux alternatifs, et la plateforme Moodle a été progressivement restaurée.

L'incident a mis en lumière une réalité plus large : « il n'y a aucune culture de la cybersécurité » sur le territoire guyanais, selon des experts interrogés à cette occasion. En dehors des secteurs soumis à des cadres réglementaires stricts — le spatial et la santé notamment — la plupart des organisations locales ne disposent d'aucune stratégie de sécurité proprement dite. En réponse à cette attaque, l'université a annoncé le recrutement d'un Responsable de la Sécurité des Systèmes d'Information (RSSI) et la réalisation d'un audit complet de ses infrastructures. Une réaction salutaire, mais qui illustre un schéma trop fréquent : la prise de conscience post-incident, là où une approche proactive aurait pu, au prix de mesures simples, rendre cette attaque impossible.

Cet exemple invite à poser une question fondamentale : comment une attaque de cette ampleur a-t-elle pu être rendue possible par une seule décision individuelle, prise des années auparavant, sur un service sans lien avec l'institution ? La réponse tient en un mot : réutilisation. Réutilisation d'un mot de passe, réutilisation d'un identifiant, et — plus profondément — réutilisation d'une habitude héritée d'un usage personnel dans un contexte professionnel où les enjeux sont d'une tout autre nature. Ce glissement, anodin en apparence, est précisément ce que les attaquants exploitent, et ce que les organisations ne peuvent laisser à la seule discrétion de chaque collaborateur.

III. Bonnes pratiques : former, gouverner, téchniser

La première réponse, et sans doute la plus structurante, réside dans la formation continue et la sensibilisation régulière de l'ensemble des collaborateurs. Non pas une formation unique dispensée lors de l'intégration et jamais renouvelée, mais un effort pédagogique ancré dans la durée, contextualisé aux usages réels de l'organisation, et renouvelé au rythme de l'évolution des menaces. Les simulations de phishing, conduites en interne ou par des prestataires spécialisés, constituent à cet égard un outil particulièrement efficace : elles permettent de mesurer le niveau de vigilance réel des équipes et d'identifier les profils les plus exposés, sans attendre qu'une attaque réelle ne le démontre.

La leçon la plus immédiate que l'on puisse tirer du cas guyanais concerne la politique des mots de passe et l'unicité des identifiants. Le principe selon lequel un mot de passe professionnel ne doit jamais être réutilisé sur un service personnel ou externe est fondamental — et pourtant systématiquement sous-estimé. Sa mise en application ne peut reposer sur la seule bonne volonté des collaborateurs : elle suppose la mise à disposition d'un gestionnaire de mots de passe institutionnel, la définition de règles claires dans la PSSI, et une sensibilisation explicite aux risques du credential stuffing. Il convient également de souligner l'existence d'outils permettant aux organisations de surveiller si des identifiants professionnels ont été exposés dans des fuites de données publiques : des services tels que Have I Been Pwned, ou leurs équivalents professionnels, permettent de détecter proactivement la présence d'adresses courriel d'entreprise dans des bases de données compromises, et d'agir avant qu'un attaquant ne le fasse.

La seconde dimension concerne la gouvernance et la politique de sécurité. Toute organisation d'une taille significative devrait disposer d'une Politique de Sécurité des Systèmes d'Information (PSSI) formalisée, approuvée au niveau de la direction, et déclinée opérationnellement dans les différents services. Cette politique doit définir clairement les règles de gestion des mots de passe, les conditions d'accès aux ressources, les procédures de signalement d'un incident suspect, et les protocoles de sauvegarde des données. L'existence d'un RSSI ou, pour les structures plus modestes, d'un référent sécurité clairement identifié, est une condition nécessaire à la mise en œuvre et au suivi effectif de cette politique.

Sur le plan technique, l'authentification multifacteur (MFA) constitue aujourd'hui le contre-mesure la plus directement efficace contre le vecteur exploité lors de l'attaque de l'Université de Guyane. Si l'accès au VPN de l'établissement avait été protégé par un second facteur d'authentification — un code généré par une application, une clé physique USB de type FIDO2, ou même un SMS — les identifiants compromis, bien que valides, n'auraient pas suffi à ouvrir une porte. Cette mesure, relativement simple à déployer, neutralise à elle seule la grande majorité des attaques par credential stuffing. Le principe du moindre privilège limite ensuite mécaniquement l'étendue des dommages qu'une compromission de compte peut causer, tandis que la segmentation du réseau contient la propagation latérale, caractéristique des ransomwares modernes, à un périmètre restreint plutôt qu'à l'ensemble du système d'information.

La question des sauvegardes mérite une attention particulière, tant elle est souvent sous-estimée jusqu'au moment où elle devient critique. Une stratégie robuste repose sur le principe dit 3-2-1 : trois copies des données, sur deux supports différents, dont une conservée hors site ou hors ligne (offline). Cette dernière dimension est essentielle face aux ransomwares modernes, qui ciblent systématiquement les sauvegardes connectées au réseau. Si l'Université de Guyane avait disposé de sauvegardes récentes et isolées, l'impact de l'attaque du groupe FOG aurait pu être considérablement réduit. Enfin, la résilience organisationnelle suppose l'existence de plans de réponse aux incidents préétablis et régulièrement testés, définissant les rôles de chaque acteur en cas de crise, les canaux de communication de substitution et les critères de décision pour des choix délicats.

IV. Conclusion — L'humain, premier risque et premier rempart

La cybersécurité constitue, en définitive, un enjeu de gouvernance autant que de technologie. Les outils existent, les bonnes pratiques sont documentées, les cadres réglementaires se renforcent. Ce qui fait encore défaut dans de nombreuses organisations — en particulier dans les institutions publiques, les collectivités territoriales et les structures de taille intermédiaire — c'est la volonté stratégique d'élever le niveau de culture du risque numérique à l'échelle de l'ensemble des collaborateurs. L'attaque de l'Université de Guyane n'est pas un cas isolé : elle appartient à une série qui frappe régulièrement hôpitaux, mairies, établissements d'enseignement et PME, avec une constance qui devrait dissiper l'illusion que ces menaces ne concernent que les grandes entreprises ou les infrastructures critiques.

Dans un environnement numérique où la frontière entre usage personnel et professionnel s'est considérablement estompée, chaque utilisateur est simultanément une ressource et un risque. C'est précisément parce qu'il est humain — faillible, pressé, confiant — qu'il représente pour les attaquants la cible de choix. Et c'est parce qu'il est humain — capable d'apprendre, de développer des réflexes, d'adopter de nouvelles pratiques — qu'il peut aussi devenir le premier rempart d'une organisation résiliente.